- Microsoft

Microsoft 365 Copilot: segurança para empresas

- 12 de mar de 2026

- 3 min de leitura

Com o avanço da inteligência artificial no ambiente corporativo, soluções como o Microsoft 365 Copilot vêm ganhando espaço ao prometer mais produtividade, agilidade na criação de conteúdos e apoio à tomada de decisão.

Ao mesmo tempo, surgem dúvidas importantes: os dados estão protegidos? As informações inseridas nos prompts podem ser utilizadas para treinar modelos? A ferramenta está em conformidade com regulamentações como GDPR e LGPD?

Neste artigo, você vai entender o que é Microsoft 365 Copilot, para que ele serve e como a solução foi estruturada para garantir segurança, privacidade e governança no uso da IA em ambientes B2B.

O que é Microsoft 365 Copilot?

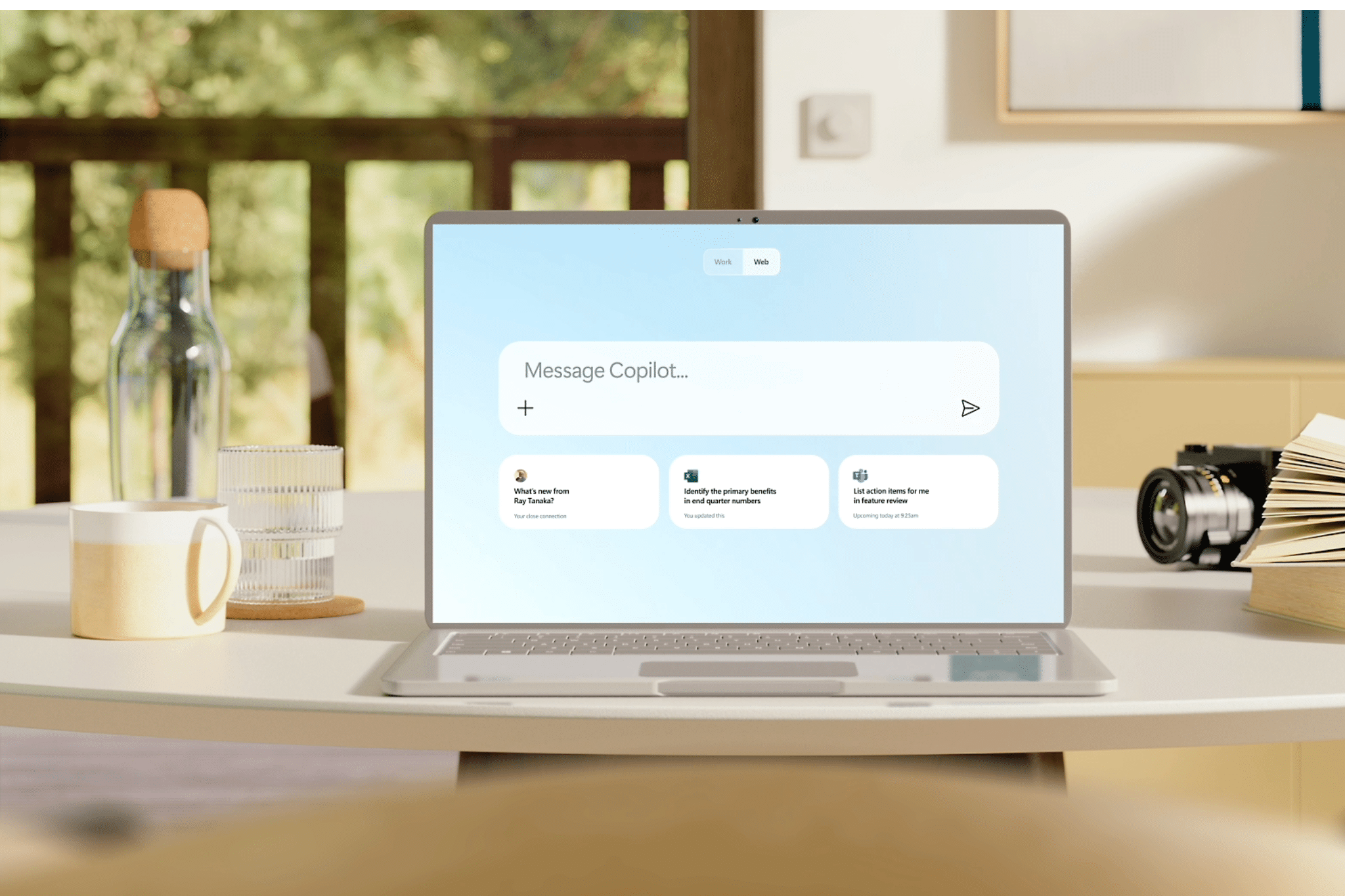

Antes de mais nada, o Microsoft 365 Copilot é uma solução integrada às ofertas comerciais do Microsoft 365 que utiliza inteligência artificial para gerar conteúdo a partir de prompts (inseridos pelos usuários) e entregar respostas baseadas no contexto corporativo.

O Microsoft 365 Copilot utiliza o contexto do usuário para criar respostas relevantes. Já o Microsoft 365 Copilot também utiliza dados do Microsoft Graph para ampliar a contextualização das informações.

Independentemente da modalidade, ambos oferecem os mesmos termos empresariais disponíveis nas ofertas comerciais do Microsoft 365.

Proteção de dados corporativos para prompts e respostas

O uso do Microsoft 365 Copilot envolve a inserção de prompts e a geração de respostas. Esses dados são protegidos pelos mesmos termos contratuais e compromissos amplamente adotados pelos clientes do Microsoft 365 para e-mails no Exchange e arquivos no SharePoint.

Ou seja, com o chamado Enterprise Data Protection (EDP), prompts e respostas recebem o mesmo nível de proteção aplicado aos dados corporativos já armazenados no ambiente Microsoft.

Microsoft 365 Copilot: como funciona a segurança?

A Microsoft ainda adota medidas para proteger os dados corporativos, incluindo:

- Criptografia em repouso e em trânsito.

- Rigorosos controles físicos de segurança.

- Isolamento de dados entre inquilinos.

Além disso, os dados permanecem privados. Ou seja, eles não são utilizados, exceto conforme instrução do cliente.

Os compromissos de privacidade incluem suporte a:

- Regulamento Geral de Proteção de Dados (GDPR).

- Limite de Dados da UE.

- ISO/IEC 27018.

- Adendo de Proteção de Dados.

Vale ressaltar que o Copilot ainda respeita o modelo de identidade e permissões já estabelecido na organização. Isso significa que:

- Herda rótulos de sensibilidade.

- Aplica políticas de retenção.

- Suporta auditoria de interações.

- Segue configurações administrativas.

Por isso, os controles e políticas específicos variam conforme o plano de assinatura contratado.

Além disso, a solução também ajuda a mitigar riscos relacionados ao uso de inteligência artificial, como:

- Conteúdo nocivo.

- Injeções de prompt.

Já para questões relacionadas a direitos autorais, a Microsoft pontua:

- Detecção de material protegido.

- Compromisso de Direitos Autorais do Cliente.

Além disso, os dados não são utilizados para treinar modelos de fundação. Os prompts, respostas e dados acessados pelo Microsoft Graph não são usados para treinamento dos modelos.

Microsoft 365 Copilot: recomendações para empresas

Mesmo com os mecanismos de proteção oferecidos, o uso responsável da inteligência artificial também exige governança interna. Por isso, vamos ver a seguir boas práticas para que as empresas garantam ainda mais segurança!

1. Solicitar documentações técnicas

O primeiro passo é pedir informações sobre governança e supervisão ética do treinamento inicial dos modelos.

2. Questionar diversidade das fontes

Além disso, garantir que os dados utilizados no treinamento inicial sejam abrangentes também é importante. Uma vez que eles apresentam diferentes contextos, minimizando riscos de vieses.

3. Avaliar conformidade regulatória

Outro ponto essencial é verificar se o treinamento inicial e o comportamento do modelo estão alinhados a regulamentações como GDPR, LGPD e demais legislações aplicáveis ao negócio.

4. Garantir responsabilidade compartilhada

Embora a Microsoft seja responsável pelo desenvolvimento do modelo, a empresa cliente também deve reconhecer seu papel no uso ético da ferramenta. A responsabilidade sobre a aplicação prática da tecnologia é compartilhada.

5. Estabelecer governança e políticas internas

É fundamental definir diretrizes claras de uso, supervisionar a implementação da solução e atribuir responsabilidades internas. Uma estrutura de governança bem definida fortalece o uso seguro da IA.

6. Treinar usuários

Por fim, capacitar os colaboradores para a utilização responsável do Copilot é indispensável. Também é recomendável estabelecer processos para que os resultados gerados sejam revisados por humanos, especialmente em decisões críticas.

Segurança e Microsoft 365 Copilot: conclusão

Ao entender o que é Microsoft Copilot e como funciona sua arquitetura de proteção de dados, fica claro que a solução foi estruturada para atender às exigências corporativas de segurança, privacidade e conformidade.

Com proteção de dados, respeito às políticas internas e compromissos contratuais consolidados, o Microsoft 365 Copilot se posiciona como uma alternativa para empresas que buscam inovação com uso seguro da IA no ambiente B2B.

Como distribuidora de tecnologia, a ScanSource apoia parceiros e empresas na adoção estratégica de soluções Microsoft, conectando inovação, governança e segurança.

Se a sua empresa deseja entender como aplicar o Microsoft 365 Copilot com segurança e conformidade, fale com a ScanSource e descubra como podemos apoiar sua jornada de transformação digital.

Deixe um comentário